随着人工智能技术的突破性发展,换脸软件(Deepfake)已从专业实验室走向大众视野。这项基于深度学习的图像合成技术,既能创造有趣的娱乐内容,也带来了身份盗用、虚假信息传播等安全隐患。本文将从技术原理、应用场景、法律风险、识别技巧和防护策略五个维度,系统解析这项引发广泛争议的AI换脸技术。

一、深度学习驱动的面部交换原理

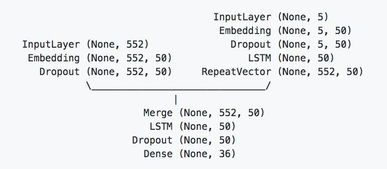

换脸软件的核心技术是生成对抗网络(GAN),该系统由生成器与判别器两个神经网络构成竞赛机制。生成器负责创建逼真的假脸图像,判别器则持续提升鉴别真伪的能力,这种对抗训练最终能生成以假乱真的换脸视频。典型算法如FaceSwap通过提取源面部特征点,将其映射到目标视频的人脸关键区域,再通过光照补偿和肤色匹配完成自然融合。

当前的AI换脸模型已能处理眨眼、微表情等细节特征,部分先进系统甚至支持实时换脸直播。但这项技术对硬件配置要求较高,处理1080P视频往往需要RTX3090级别显卡支持。用户在使用免费换脸软件时,如何确保个人生物数据安全?这需要从软件授权协议和数据加密机制两方面进行考量。

二、娱乐与犯罪的二元应用场景

在影视制作领域,换脸技术正革新后期制作流程。好莱坞已使用Deepfake修复经典影片,将已故演员数字复活。短视频平台则涌现大量明星换脸创作,这类UGC内容虽具娱乐性,却涉及肖像权等法律问题。更值得警惕的是,网络诈骗者利用伪造视频冒充企业高管实施商业欺诈,2023年香港某上市公司就因此损失800万美元。

医疗领域正在探索换脸技术的正向价值,为面部创伤患者生成治疗预期效果图。但恶意使用案例同样触目惊心,某色情网站流量分析显示,98%的Deepfake视频未经当事人同意。这种技术滥用对个人名誉的破坏,可能比传统PS严重十倍不止。

三、全球监管框架与法律盲区

欧盟《人工智能法案》将深度伪造技术列为高风险系统,要求所有换脸软件必须植入数字水印。美国已有23个州立法规定,传播恶意换脸内容将面临刑事指控。但法律执行面临技术认定难题:如何界定”合理使用”与”恶意伪造”的边界?现有司法鉴定体系在检测AI生成的微表情时,准确率仅为78%。

中国网络安全法第46条明确规定,不得利用AI技术制作、传播虚假信息。2023年广州互联网法院审理的”AI换脸侵权第一案”,判决被告赔偿经济损失并公开道歉。但跨国网络平台的内容监管仍存在漏洞,约35%的违规换脸视频通过境外服务器传播。

四、九大特征识别深度伪造内容

普通用户可通过观察以下异常迹象辨别换脸视频:1.眨眼频率不符合生理规律;2.面部光照方向与环境光源矛盾;3.发际线边缘存在像素扭曲;4.语音与口型细微不同步;5.皮肤纹理缺乏毛孔细节。专业检测工具如Microsoft Video Authenticator,能分析视频元数据中的算法指纹。

最新研究显示,深度伪造视频在心率同步性上存在破绽。真实人物的面部微血管搏动频率与语音节奏存在关联,而AI生成的换脸视频尚未完美模拟这种生理特征。但检测技术是否总能领先伪造技术?这需要持续的技术攻防与算法迭代。

五、构建三位一体防护体系

个人防护应从生物信息管理做起,避免在不明平台上传清晰正脸照片。企业级防护需要部署多模态认证系统,结合声纹识别与行为特征分析。技术开发者则需遵循伦理准则,在换脸软件中内置使用协议验证模块,要求用户上传身份证明与肖像授权书。

区块链技术为数字内容溯源提供新思路,阿里巴巴达摩院开发的”AI防伪溯源系统”,可将创作信息加密写入视频元数据。政府层面正在推进生物特征数据脱敏标准,未来公民面部信息或将以特征向量形式存储,从根本上杜绝原始数据泄露风险。

换脸软件作为双刃剑技术,既展现了人工智能的创造力,也暴露出数字时代的身份危机。从技术开发者到普通用户,都需要建立算法伦理意识。未来三年内,预计全球将形成统一的Deepfake认证标准,生物识别技术也将升级至活体检测4.0时代。只有技术创新与法律监管同步进化,才能确保换脸软件在可控范围内造福社会。

相关文章